Se no passado a manipulação eleitoral exigia tempo, estrutura e coordenação, hoje ela pode ser executada com poucos recursos e alto impacto. Os deepfakes representam uma das maiores rupturas já vistas no ambiente informacional. Não se trata mais de editar uma fala ou distorcer uma imagem. Trata-se de criar uma realidade paralela, com aparência absolutamente legítima. Vídeos de candidatos dizendo algo que nunca disseram, áudios com entonação perfeita, expressões faciais coerentes e contextos aparentemente reais já fazem parte do cenário eleitoral global e das eleições brasileiras de outubro de 2026.

O mais preocupante não é apenas a existência dessa tecnologia: é a velocidade com que ela evolui e se democratiza. Ferramentas antes restritas a laboratórios de pesquisa hoje estão disponíveis comercialmente, com interfaces simples e acessíveis a qualquer pessoa com um computador e acesso à internet. Segundo o relatório da empresa de segurança Sumsub, o número de deepfakes detectados globalmente cresceu 900% entre 2023 e 2024. Qualquer campanha, candidato ou figura pública pode se tornar alvo ou vetor, desse tipo de manipulação. E outubro está mais perto do que parece.

O Brasil já tem cicatrizes. Nas eleições municipais de 2024, o Tribunal Superior Eleitoral identificou o uso de vídeos sintéticos para simular declarações de candidatos. O que era experimento virou prática. O que era esporádico tende a se tornar sistemático. Em fevereiro de 2024, às vésperas das eleições presidenciais eslovacas, um áudio falso atribuído ao candidato Michal Simecka simulava uma conversa sobre compra de votos. O conteúdo era mentira. Mas o estrago estava feito antes de qualquer desmentido alcançar a mesma audiência. Esse será o manual das eleições brasileiras de 2026, se nada mudar.

A lógica da comunicação digital favorece a propagação inicial, não a correção posterior. Um conteúdo falso bem construído pode destruir uma reputação em questão de horas. E mesmo quando desmentido, o dano já está feito porque, nem todos que viram a mentira verão o desmentido. A dúvida, por si só, já é suficiente para comprometer a confiança. E em um ambiente eleitoral, dúvida é um ativo destrutivo, especialmente nas últimas 72 horas antes da votação, quando não há tempo para qualquer reação.

Para o eleitor, o desafio se torna quase impossível. Estudos do MIT demonstram que seres humanos conseguem distinguir um deepfake de um vídeo real em apenas 50% dos casos, desempenho equivalente ao do acaso. Isso significa que ver não é mais acreditar. Ouvir também não. A decisão de voto de milhões de brasileiros poderá ser influenciada por conteúdos que nunca existiram, produzidos por atores que jamais assinarão o que fizeram.

Para candidatos e equipes de campanha, o problema deixa de ser apenas comunicação e passa a ser defesa permanente. Monitorar, antecipar e reagir a conteúdos falsos torna-se parte da estratégia central. Não se trata mais de evitar erros, mas de se proteger contra fatos que nunca existiram. Campanhas que chegarem a outubro sem um protocolo claro de resposta a deepfakes chegarão despreparadas para o campo de batalha real.

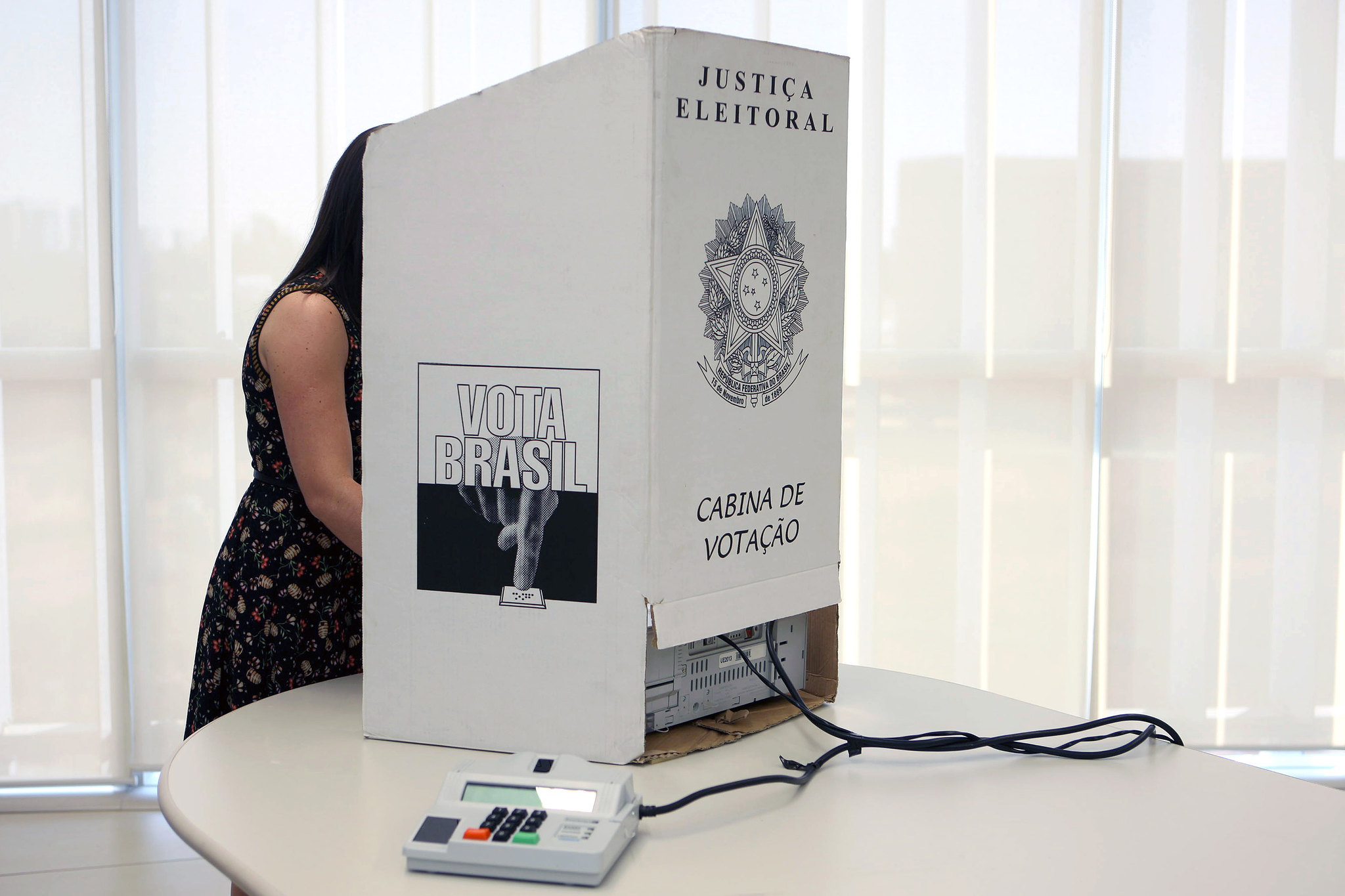

E para as instituições públicas, responsáveis pelas eleições, o desafio é estrutural: como garantir integridade informacional em um ambiente onde a própria evidência pode ser fabricada? A União Europeia avança com o AI Act. O Brasil debate. O TSE regulamentou o uso de IA nas eleições de 2024, mas a capacidade de fiscalização ainda está muito aquém da velocidade de produção e distribuição de conteúdos sintéticos. O tempo não espera — e outubro também não.

Este assunto é primordial e preocupante para o Brasil em outubro, pois iremos eleger o próximo presidente, os deputados federais, 2/3 dos senadores e os deputados estaduais e serão provavelmente mais de 30 mil candidatos, cada um deles um alvo potencial de deepfakes, distribuídos por 26 estados e o DF, disputando atenção em um ambiente digital onde a mentira circula mais rápido que o desmentido.

Os deepfakes não são apenas uma inovação tecnológica. São uma mudança estrutural na forma como a realidade pode ser construída, manipulada e distribuída. Candidatos, eleitores e instituições precisam chegar a outubro com os olhos abertos. Ignorar esse risco não é ingenuidade. É uma escolha — e suas consequências serão medidas nas urnas.

Oscar Soares Martins é consultor e especialista em cibersegurança e em IA.

* A opinião do articulista não reflete necessariamente a opinião do PNB Online